您可以通过组合面部表情分析系统可识别的 动作单元 来自定义面部表情或心理状态。此外,也可以在自定义表情时使用效价,唤醒度,头部朝向(AU51-56),心率和心率变异性。

自定义表情功能的应用范围十分广泛,例如:

*如果您对测试或验证这些内容有兴趣,请与我们联系。如果您已经开发了自己的自定义表情,并希望与其他研究人员分享,请联系我们!!

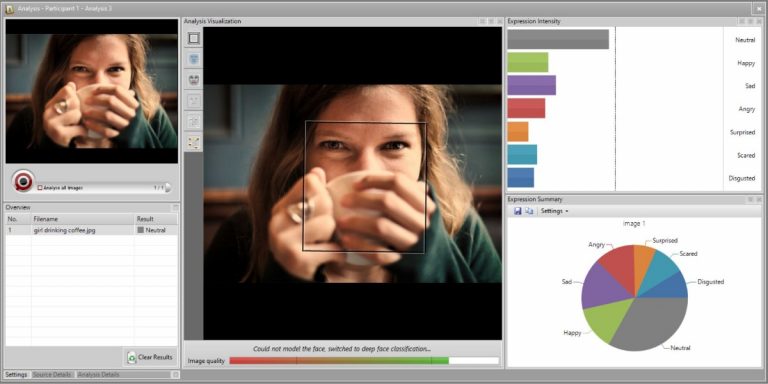

面部表情分析系统可以将被试的面部表情可视化为条形图、饼状图和折线图。情绪环形模型可以体现情绪的负性或正性(效价)。通过时间轴,可对数据进行详细的可视化再现。

面部表情分析系统会在单独的报告窗口中显示带有百分比的饼状图,笑脸和信号灯,说明一个人的情绪是正面、中立还是负面。系统会实时提供所有可视化数据,并且支持反复查看数据。在项目分析模块中,系统可以提供高级的面部表情分析。

通过使用Deep Face模型分类引擎,面部表情分析系统可以处理大量复杂的数据。

Deep Face模型应用了深度学习,它基于人工神经网络,在输入和输出之间建立多个卷积层,计算每个输出结果的概率。

目前,Deep Face模型是机器学习中一项成功的人工智能技术。像真实的神经网络一样,输入端的信息由与之相连的神经元收集和处理,输入到输出的映射通过一系列非线性计算,将较低级别的信息汇总以形成较高级别的功能。(例如表达的情感,年龄,性别等)。